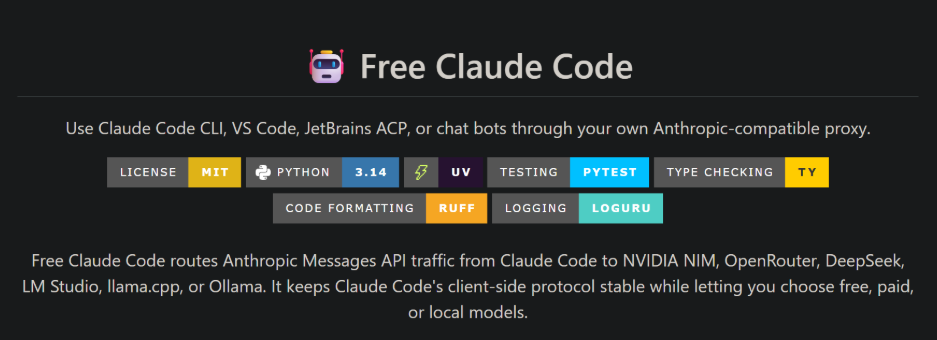

Free Claude Code ,让 Claude Code 接入任何模型

发布日期:2026/5/9 10:36:39 浏览量:

Free Claude Code 的架构非常清晰,本质上是一个中间件代理:

用户操作(Claude Code / VS Code / JetBrains 插件)

↓

free-claude-code 代理服务

↓

转发请求

↓

[ NVIDIA NIM | OpenRouter | DeepSeek | LM Studio | llama.cpp | Ollama ] 复制

正常流程:Claude Code → Anthropic API → Claude 模型

加了 Free Claude Code:Claude Code → free-claude-code 代理 → 你选的服务商 → 对应模型

这个代理做了两件事:

- 接收 Claude Code 发出的 API 请求(格式兼容)

- 转发给配置的目标服务商(做必要的格式转换)

也就是说,Claude Code 的请求格式基本兼容主流 LLM API,所以转发在技术上是可行的。

三、支持的后端服务商

|

|

|

|---|---|

| NVIDIA NIM | NVIDIA 官方模型托管,支持Llama/Phi等 |

| OpenRouter | 聚合多个模型 API,$5免费额度,支持free模型 |

| DeepSeek | 国产顶级模型,API 价格低,支持 V3 / Coder |

| LM Studio | 本地模型运行,零API费用,完全离线 |

| llama.cpp | 纯C++推理引擎,支持GGUF格式本地模型 |

| Ollama | 本地模型管理,支持 hundreds of models |

重点说说 LM Studio 和 Ollama:如果你有一块不错的显卡(8GB+ 显存),完全可以把模型跑在本地,完全免费,而且数据不出本机,隐私有保障。

未来 AI 编程工具的竞争,不只是在"模型层",更会在"协议兼容层、路由层、工具层和工作流层"。

复制

Claude Code 的交互体验(Terminal 工作流、工具调用、上下文管理)是目前最好的,但它绑定了 Anthropic 模型。Free Claude Code 证明了一个思路:交互层和模型层完全可以解耦。

这意味着:

- 一个好的 Agent 交互框架,未来可以对接任意模型

- 路由层(选哪个模型)可以变得更智能

- 本地模型 + 好用的交互层 = 完全私有的 AI 编程环境

安装

npm install -g free-claude-code复制

配置后端

设置环境变量,选择要使用的前端和后端组合:

# Claude Code 前端 + OpenRouter

export CLAUDE_CODE_FRONTEND=claude-code

export BACKEND_PROVIDER=openrouter

export OPENROUTER_API_KEY=sk-or-...

# 或者 Claude Code 前端 + DeepSeek

export BACKEND_PROVIDER=deepseek

export DEEPSEEK_API_KEY=sk-

启动代理

npx free-claude-code proxy复制

使用

在 Claude Code、VS Code 的 Cline 插件、或 JetBrains 的 JetBrains AI Assistant 中配置代理地址,即可开始使用。

项目地址: https://github.com/Alishahryar1/free-claude-code

马上咨询: 如果您有业务方面的问题或者需求,欢迎您咨询!我们带来的不仅仅是技术,还有行业经验积累。

QQ: 39764417/308460098 Phone: 13 9800 1 9844 / 135 6887 9550 联系人:石先生/雷先生